Forscher bei Apple haben zwei neue wissenschaftliche Papiere verfasst, in denen Methoden beschrieben werden, die es ermöglichen, große Sprachmodelle (LLMs) wie ChatGPT und die Erstellung animierter 3D-Avatare auf iPhones und ähnlichem zu betreiben. Dies könnte den Weg für Apple ebnen, seinen eigenen "Apple GPT" zu bauen.

Apple GPT lokal auf dem iPhone

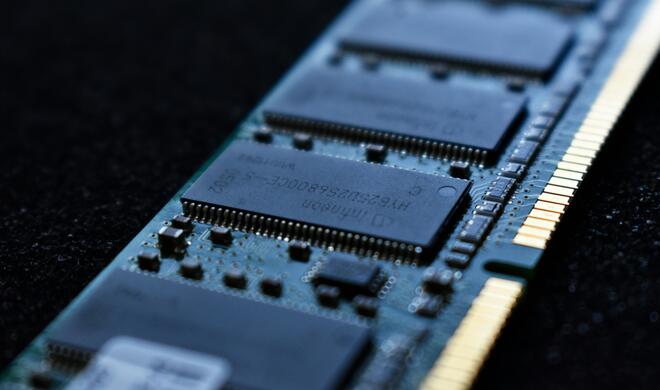

Eine Arbeit mit dem Titel "LLM in a flash" konzentriert sich auf die Optimierung der Interaktion von LLMs mit dem Gerätespeicher und dem Flash-Speicher, um die Limitierungen kleiner Geräte zu umgehen.

Dieser Durchbruch könnte entscheidend sein, um hochentwickelte LLMs auf iPhones und andere Geräte mit begrenztem Arbeitsspeicher zu bringen. Er könnte auch dazu beitragen, den Zugang und die Anwendungen für KI-Chatbots wie den gerüchteweise angekündigten Apple GPT zu erweitern.

In einem anderen Beitrag wird eine Technik zur automatischen Erzeugung animierter 3D-Avatare aus kurzen 2D-Videoclips beschrieben. Im Gegensatz zu den vorherrschenden Methoden, die mehrere Kameras erfordern, funktioniert der Ansatz von Apple mit einem typischen Smartphone-Video.

Ihr Algorithmus kann in nur 30 Minuten ein vollständig animierbares 3D-Modell mit entkoppelter Hintergrundszene und menschlicher Darstellung erstellen. Das ist etwa 100 Mal schneller als bestehende Alternativen.

Diese Einfachheit könnte es iPhone-Besitzern ermöglichen, virtuelle Anproben, 3D-Selfies für Vision Pro und andere Anwendungen zu erstellen. Konkrete Pläne und Zeitpläne für den Einsatz der Fortschritte in den beiden Papieren sind jedoch noch nicht bekannt.

Wann werden wir diese KI-Fähigkeiten sehen?

Der Analyst Ming-Chi Kuo sagte im August 2023 , dass es noch keine Anzeigen dafür gibt, dass Apple im Jahr 2024 einen eigenen KI-Chatbot ausliefern wird. Das Gleiche gilt wahrscheinlich für die Funktionen zur Erstellung von Avataren, trotz der offensichtlichen Verbindungen zu Apples AR- und Metaverse-Ambitionen in Bereichen wie der räumlichen Videoerfassung Vision Pro.