Apple arbeitet Gerüchten zufolge weiterhin an einem neuartigen Wearable in der Größe eines AirTag, das mit Kameras ausgestattet sein und eng mit dem iPhone zusammenarbeiten soll. Laut Bloomberg-Journalist Mark Gurman könnte das Gerät bereits im kommenden Jahr auf den Markt kommen – allerdings befindet sich die Entwicklung noch in einem frühen Stadium.

- Apple entwickelt ein AirTag-großes Pendant mit Kamera, Mikrofon und Siri-Integration als iPhone-Zubehör.

- Das Gerät hat einen eigenen Chip, benötigt aber das iPhone für die meiste Rechenleistung und könnte 2027 erscheinen.

- Parallel arbeitet Apple an Smart Glasses und kamerabestückten AirPods, während die Zukunft des Pendants noch ungewiss bleibt.

Ein Pendant als iPhone-Zubehör

Das als „Pendant“ oder „AI Pin“ bezeichnete Accessory soll etwa die Größe eines AirTag haben und erinnert konzeptionell an den gescheiterten Humane AI Pin. Anders als dieser soll Apples Variante jedoch kein eigenständiges Produkt sein, sondern als Zubehör für das iPhone fungieren. Einige Apple-Mitarbeitende beschreiben das Gerät intern als die „Augen und Ohren“ des iPhone.

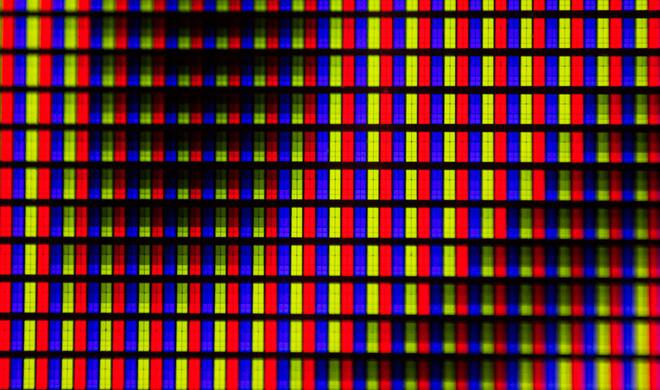

Das Wearable verfügt über eine dauerhaft aktive Kamera und ein Mikrofon für Siri-Sprachbefehle. Ein Display oder Laserprojektor sind hingegen nicht vorgesehen. Während die Kamera nach Informationen von Bloomberg lediglich eine niedrige Auflösung haben und der visuellen Kontexterfassung dienen soll, berichten andere Quellen von zwei Frontkameras – einer mit Standardobjektiv und einer mit Weitwinkel – zum Aufnehmen von Fotos und Videos.

Begrenzte Rechenleistung erfordert iPhone-Unterstützung

Im Inneren des Pendants arbeitet ein eigener Chip, dessen Leistung jedoch begrenzt ist. Ähnlich wie beim H2-Chip in den AirPods wird der Großteil der Rechenarbeit vom gekoppelten iPhone übernommen. Apple diskutiert derzeit noch, ob das Accessoire einen Lautsprecher für bidirektionale Siri-Konversationen und Audiowiedergabe erhalten soll.

Visual Intelligence ist eine iPhone-Funktion, die mithilfe der Kamera visuelle Informationen über Orte und Objekte in der Umgebung liefert. Die Technologie analysiert das Kamerabild in Echtzeit und kann beispielsweise Veranstaltungsdaten aus physischen Texten auslesen und in den Kalender eintragen. Bei Apples geplanten Wearables soll Visual Intelligence genutzt werden, um Siri Kontext über die Umgebung der Nutzenden zu geben.

Flexible Tragemöglichkeiten

Nutzende können das Pendant mit einem Clip an der Kleidung oder einer Tasche befestigen. Alternativ lässt sich durch eine Öffnung im Gerät eine Kette oder Schnur führen, sodass es als Halskette getragen werden kann. Die Energieversorgung erfolgt wie bei der Apple Watch über kabelloses Laden.

Integration mit iOS 27 und verbessertem Siri

Das Pendant soll voraussichtlich mit den überarbeiteten Siri-Funktionen von iOS 27 zusammenarbeiten. Apple entwickelt derzeit eine Chatbot-Version von Siri, die auf KI-Modellen von Google basiert und mit Assistenten wie Claude, Gemini und ChatGPT konkurrieren soll. Die visuelle Kontexterfassung könnte dabei eine zentrale Rolle spielen – ähnlich der aktuellen Visual Intelligence-Funktion auf neueren iPhones.

Smart Glasses als weitere Wearable-Option

Parallel zum Pendant arbeitet Apple an einer Smart Glasses, die Ende 2026 oder Anfang 2027 vorgestellt werden könnte. Die Markteinführung ist jedoch frühestens für 2027 geplant. Ähnlich wie die Meta Ray-Ban werden Apples Brillen über integrierte Kameras zum Aufnehmen von Fotos und Videos verfügen sowie Lautsprecher und Mikrofone für Musik, Telefonate und Siri-Benachrichtigungen bieten.

Apple legt besonderen Wert auf eine enge iPhone-Integration und hochwertige Verarbeitung. Die Kameras sollen Daten an Siri und Apple Intelligence liefern und Funktionen wie Fußgängernavigation mit Schritt-für-Schritt-Anweisungen verbessern. Anders als bei Meta entwickelt Apple eigene Kunststoffrahmen und testet mindestens vier Designvarianten – von größeren rechteckigen Fassungen im Wayfarer-Stil bis zu kleineren ovalen oder runden Modellen. Farboptionen wie Schwarz, Ozeanblau und Hellbraun stehen zur Diskussion.

Im Gegensatz zu Meta Ray-Ban plant Apple für die erste Generation keine Augmented-Reality-Anzeige im Brillenglas. Die Brillen sollen jedoch mit vertikal ausgerichteten, ovalen Kameraobjektiven ausgestattet sein.

Ungewisse Zukunft des Projekts

Trotz der fortlaufenden Entwicklung bleibt die Zukunft des Pendants unsicher. Da sich das Projekt noch in einem frühen Stadium befindet, besteht weiterhin die Möglichkeit einer Einstellung. Sollte Apple die Entwicklung fortsetzen, könnte das Gerät frühestens 2027 auf den Markt kommen – zeitgleich mit den geplanten Smart Glasses und möglicherweise kamerabestückten AirPods Pro.

Die Konkurrenz schläft derweil nicht: OpenAI entwickelt gemeinsam mit dem ehemaligen Apple-Designer Jony Ive ein KI-Gerät, das ebenfalls 2027 erscheinen könnte. Während andere KI-Wearables wie der 700 US-Dollar teure Humane AI Pin am Markt gescheitert sind, setzt Apple auf ein anderes Konzept – ein Accessoire, das die Fähigkeiten des iPhone erweitert, statt es zu ersetzen.

Ein HomePod, aber zum Mitnehmen und ohne die Lautsprecher-Funktion. Für mich klingt das entweder nach einem Zwischenschritt zu Smart-Glasses oder nach einem Addon für „Hey Siri“. Wobei ich mich da frage, ob das nicht auch die Apple Watch hätte erledigen können? Klar hätte es für „Visual Intelligence“ Vorteile, wenn die Kamera sieht, was ich sehe, und die Uhr müsste man dann entsprechend ausrichten – aber dafür hätte Apple damit quasi für automatische Verbreitung gesorgt.